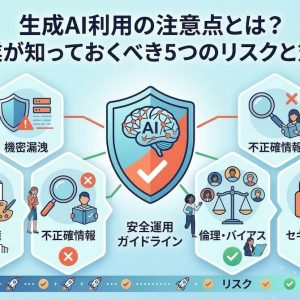

業務効率化や新規事業の創出において、生成AIの活用は今や企業にとって避けては通れないテーマとなりました。ChatGPTをはじめとするツールの普及により、誰もが手軽に高度なアウトプットを得られるようになった一方で、導入にあたっての生成AIの注意点を正しく理解できている担当者はまだ多くありません。

安易な利用は、企業の信頼を揺るがす重大なトラブルを招く恐れがあります。ビジネスの現場で成果を出すためには、生成AIの注意点を体系的に把握し、適切なリスク管理体制を築くことが不可欠です。

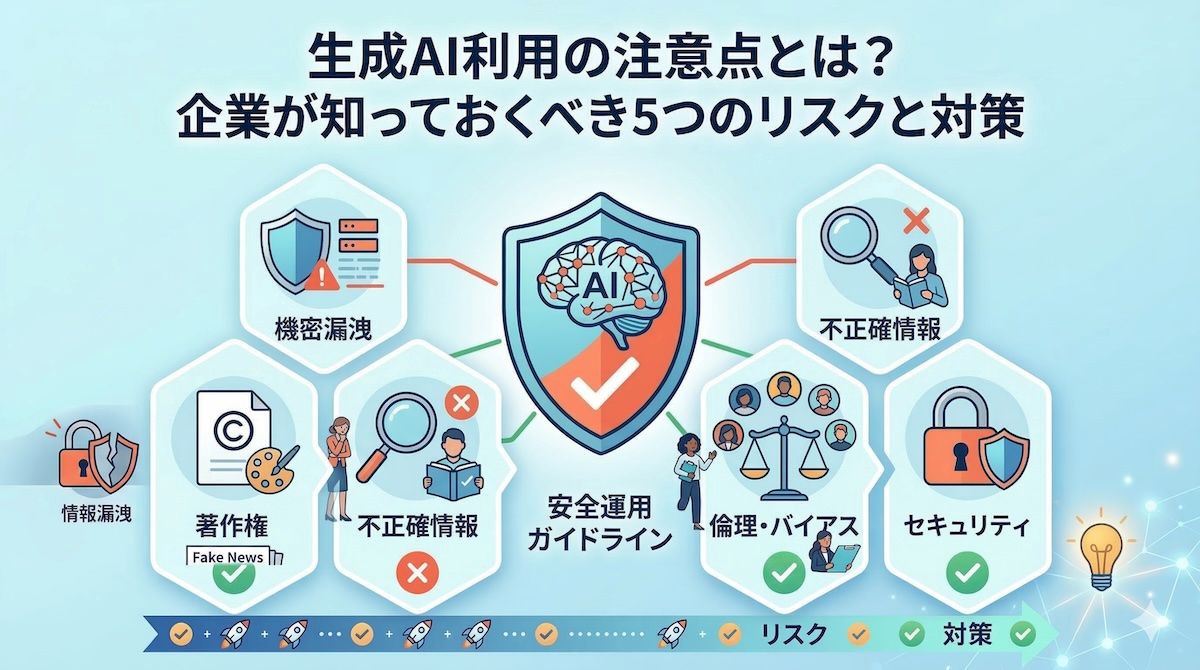

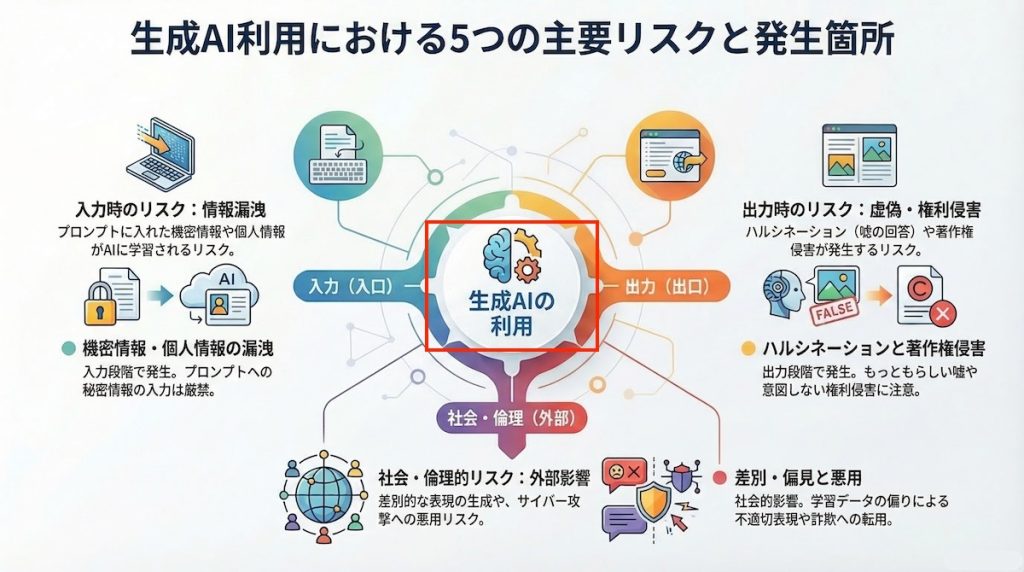

本記事では、企業が直面しやすい5つの主要なリスクを整理し、安全に運用するための具体的な対策を解説します。社内ガイドラインの作成や、現場での運用ルール構築にぜひお役立てください。

目次

生成AIの利用で企業が注意すべき5つの主なリスク

生成AIは極めて便利なツールですが、ビジネスで利用する際には特有のリスクが伴います。これらを無視して導入を進めると、法的トラブルや社会的信用の失墜を招く恐れがあるため、まずは生成AIの注意点として以下の5つのリスクを正しく理解しておきましょう。

機密情報や個人情報の漏洩リスク

最も警戒すべきは、入力したデータがAIの学習に利用されることによる情報漏洩のリスクです。

標準的な設定のまま機密情報や顧客の個人情報を入力すると、その内容をAIが学習し、他者の回答として出力されてしまう可能性があります。実際、2023年にはユーザーのチャット履歴が他ユーザーに表示される事例も発生しています。

企業として利用する際は、入力データが学習に利用されない「オプトアウト設定」や「API利用」を検討することが不可欠です。

著作権侵害および所有権を巡るトラブル

生成AIが作り出した画像や文章が、既存の著作物と酷似していた場合、著作権侵害に問われるリスクがあります。

AIの学習データには膨大な既存コンテンツが含まれており、意図せず他者の権利を侵してしまうケースは少なくありません。海外では、学習データに無断で著作物を使用したとして、いくつかの訴訟問題に発展している事例もあります。

AI生成物の著作権が誰に帰属するのかという法的な議論は続いており、商用利用の際は細心の注意を払う必要があります。

不正確な情報(ハルシネーション)による信頼失墜

AIがもっともらしい嘘をつく「ハルシネーション(幻覚)」も、代表的な生成AIの注意点です。

AIは確率的に言葉をつなげているに過ぎず、事実に基づかない回答を生成することがあります。誤った情報をそのまま社外へ発信したり、意思決定の根拠にしたりすると、企業の専門性や誠実さが疑われる結果になりかねません。

アメリカでは、弁護士がAIを使って「実際には存在しない判例や引用」を含んだ法的意見書を作成、裁判所に提出し問題となりました。

権利侵害やバイアスによる倫理的リスク

AIの学習データに偏りがある場合、生成物に差別的な表現や偏見が含まれるリスクがあります。

AIは「差別してはいけない」と本質的に理解しているわけではないため、学習データに含まれる社会的な偏見を、そのまま出力してしまう可能性があります。特定の属性に対して不適切な回答を出力してしまい、それが公開された場合、企業のコンプライアンス姿勢が厳しく問われます。

社会的な公平性を保つためにも、出力内容が倫理的に問題ないかを確認するプロセスが重要です。

サイバー攻撃や不正利用への加担

悪意のあるプロンプト(指示文)によって、AIにコンピューターウイルスを成させたり、フィッシングメールの文案を作らせたりする不正利用のリスクも存在します。自社の従業員が意図せずとも、AIを介してセキュリティホールを探るような行為に加担してしまう可能性も否定できません。

香港では、詐欺グループがディープフェイク技術を使ってとある企業の偽物のCFOを作り出し、従業員に約38億円を送金させるという事件が発生しています。ツールの利用目的を明確にし、逸脱した使い方がなされないよう監視する体制が求められます。

【実務編】生成AIを安全に活用するための3つの注意点

リスクを把握した次は、それらを防ぐための具体的なアクションが求められます。現場の従業員が迷わず、かつ安全にツールを使いこなすために、以下の3つの生成AIの注意点を運用ルールに組み込みましょう。

入力データに機密情報を含めない運用の徹底

情報漏洩を防ぐ最も確実な方法は、機密情報を入力しないというルールの徹底です。

顧客の個人名、電話番号、未発表のプロジェクト資料、ソースコードなどをプロンプトに含めることは原則禁止すべきです。もし業務上どうしても機密情報を扱う必要がある場合は、データがAIの学習に利用されない「API連携版」の導入や、設定画面から「学習オフ(オプトアウト)」を選択することを社内で義務付ける必要があります。

出力結果の「ファクトチェック」を必須工程にする

AIが生成した回答をそのまま鵜呑みにせず、必ず人間が内容の正確性を確認するファクトチェックを工程に加えましょう。

特に、専門的な数値、法律、歴史的事実、最新のニュースなどは、AIがハルシネーション(もっともらしい嘘)を起こしやすい箇所です。複数の信頼できる一次ソース(官公庁のサイトや専門書など)と照らし合わせ、根拠が不明確な情報は採用しないという姿勢が、企業の信頼を守る鍵となります。

AI生成物であることを明示する透明性の確保

社外向けのコンテンツやカスタマーサポートなどでAIを活用する場合、それがAIによって生成されたものであることを明示することも重要な注意点です。読者や顧客に対して「人間が書いたもの」と誤認させることは、後に発覚した際のリスク(不信感)を増大させます。透明性を確保することで、万が一内容に不備があった際の説明責任を果たしやすくなり、ブランドイメージの保護につながります。

トラブルを防ぐ!社内向け「生成AI利用ガイドライン」の作成ポイント

個人のリテラシーに頼るだけでは、組織としてのリスク管理は不十分です。企業が安全にツールを導入するためには、全社共通の「生成AI利用ガイドライン」を策定し、運用ルールを明文化することが欠かせません。ここでは、ガイドラインに盛り込むべき具体的な生成AIの注意点とポイントを解説します。

利用可能なツールと禁止事項を明確化する

まず、会社が「利用を認めるツール」と「禁止する行為」を明確に定義しましょう。

例えば、「ChatGPTの有料版(チームプラン以上)は利用可だが、無料版は学習に利用されるため原則禁止」といった具体的な指定が必要です。また、プログラムのソースコードや顧客情報の入力など、絶対にやってはいけない禁止事項をリストアップし、現場の社員が判断に迷わない基準を提示することが重要です。

最も安全なのは、自社で独自のAIツールを開発・運用することですが、実現のハードルは低くありません。必要に応じて、企業利用を前提としたセキュリティ水準の高いツールの導入を検討するのも一つの選択肢です。

万が一の事故が発生した際の報告フローを定める

どれだけ注意を払っていても、誤って機密情報を入力してしまうなどの人的ミスを完全にゼロにすることは困難です。そのため、問題が発生した際の緊急連絡先や報告フローをあらかじめ決めておく必要があります。

隠蔽や報告の遅れは被害を拡大させるため、「ミスを責めるのではなく、迅速に報告して対処する」という組織文化の醸成も、実務上の大きな注意点と言えるでしょう。

【ケース別】業務で生成AIを利用する際の具体的な注意点

次は日々の実務シーンに即した生成AIの注意点を確認しましょう。特によく活用される4つのケースにおいて、陥りやすい落とし穴と対策をまとめました。

コラム記事・メールなどの「文章作成」で利用する場合

オウンドメディアの記事執筆や、顧客へのメール文案作成に生成AIを活用する際は、情報の正確性と自社らしいトーン&マナーの維持に注意が必要です。

AIが生成する文章は、一見整っているようで「同じ語尾が連続する」「内容が薄く抽象的」といった特徴が出がちです。また、下書きを依頼する過程で、うっかりプロジェクトの機密名称や顧客名を入力しないよう、固有名詞を伏せ字にするなどの工夫が欠かせません。最終的には必ず人間が読み直し、自社のブランドイメージに合致した表現へとリライトする工程を挟みましょう。

【対策】

- 生成文は公開前に必ず人間が事実確認を行う

- 固有名詞や機密情報は入力せず、伏せ字や一般化した表現に置き換える

- 語尾や表現の重複を見直し、自社らしい文体に調整する

生成AIを活用した記事作成の方法については以下の記事で詳しく解説しています。

生成AIを活用しブログ記事を作成する方法|便利ツール6選

提案書やプレゼン用「スライド資料」を作成する場合

企画の骨子やキャッチコピーのアイデア出しをAIに頼る場合、その提案が「どこかで見たような凡庸な内容」になっていないかを確認することが重要な生成AIの注意点です。

AIは学習データに基づいた「平均的な回答」を得意とするため、そのままでは競合他社との差別化が難しくなります。また、プレゼン資料にAI生成画像を挿入する際は、その画像が特定の著名なクリエイターの作風を不自然に模倣していないか、商用利用が許可されているモデルかを確認し、権利トラブルを未然に防ぐ姿勢が求められます。

【対策】

- AIの提案はそのまま使わず、自社ならではの視点や事例を加える

- 競合と比較し、内容やが似通っていないか確認する

- 生成画像に著作権の懸念がある場合、既存素材に差し替える

プログラミングやコード生成で利用する場合

エンジニアがコードの自動生成やバグチェックにAIを利用する場合、セキュリティの脆弱性とライセンスに細心の注意を払う必要があります。

AIが提案したコードに、古いライブラリの使用や脆弱性が含まれている可能性は否定できません。また、オープンソースのライセンス(GPLなど)に抵触するコードが混入すると、自社のソースコード全体の公開を迫られるリスクもあります。生成されたコードは必ず人の目でレビューし、社内のセキュリティ基準を満たしているかを検証するプロセスを徹底してください。

【対策】

- 生成コードは必ず人がレビューし、安全性と妥当性を確認する

- 使用ライブラリや外部コードのライセンス条件を確認する

- 脆弱性診断ツールや静的解析ツールを併用する

画像生成をマーケティングに利用する場合

バナー広告やSNS投稿用の画像を生成する際は、倫理的・法的な権利関係が最大の注意点となります。

特定の作家や写真家のスタイルを露骨に指定して生成された画像は、法的にグレーであっても、SNS上での「炎上リスク」を孕んでいます。また、人物画像を生成する際には、特定の人種や職業に対して偏見を持った描かれ方をしていないかチェックすることも、企業の社会的責任(CSR)の観点から非常に重要です。

【対策】

- 「パクリ」と受け取られかねない指示や画像は避ける

- 公開前に権利面と表現面を人がチェックする

- 人物表現は偏見や固定観念を助長していないか確認する

生成AIの使い方については以下の記事でも分かりやすく解説していますので、興味がある方は併せてお読みください。

初心者でも安心!生成AIの使い方と活用事例ガイド

生成AIの進化と向き合い、リスクを抑えて成果を最大化しよう

生成AIは、正しく活用すれば企業の生産性を劇的に向上させる強力なパートナーとなります。しかし、今回解説した生成AIの注意点を軽視すると、情報漏洩や著作権侵害といった取り返しのつかないリスクを招くことにもなりかねません。大切なのは、AIの特性を正しく理解し、人間が最終的な責任を持つ「共生」の形を築くことです。

まずは社内で共通のガイドラインを策定し、入力時のセキュリティ確保や出力結果のファクトチェックを標準的な業務フローとして定着させましょう。リスクを恐れて活用を止めるのではなく、ルールに基づいた安全な運用を徹底することで、AIがもたらす恩恵を最大限に享受できるようになります。技術の進化は止まりませんが、それを受け入れる組織側のリテラシー向上こそが、持続可能なDX推進の鍵となるはずです。

もし、自社に最適な生成AIの導入ルール作りや、安全なコンテンツ制作体制の構築でお悩みでしたら、ぜひシンプリックへご相談ください。貴社の状況に合わせた、実務的で成果の出るメディア運用をサポートいたします。